L’hybris de certains psychopathes pleins d’argent (monnaie de singe, en fait) et donc de pouvoir usurpé nous fabrique un monde merdique : fanatisme climatolâtre, viol de l’anthropologie naturelle au bénéfice des pervers, cosmopolitisme dément, négation de l’autonomie d’expression, asservissement des peuples à l’aide de techniques insidieuses, et j’en passe.

L’hybris de certains psychopathes pleins d’argent (monnaie de singe, en fait) et donc de pouvoir usurpé nous fabrique un monde merdique : fanatisme climatolâtre, viol de l’anthropologie naturelle au bénéfice des pervers, cosmopolitisme dément, négation de l’autonomie d’expression, asservissement des peuples à l’aide de techniques insidieuses, et j’en passe.

Lisant au hasard une brève sur le site d’informatique Code Project, je tombe sur une nouvelle sagouinerie des GAFAs. Cette fois, c’est le monopole Google qui est visé pour activité d’espionnage des particuliers. J’ai traduit un article indiqué en lien sur le site. Son auteur : Adam Clark Estes. Lien ici. J’ai essayé de conserver le ton assez sarcastique de l’original et son registre situé entre la langue populaire et l’argot. Voici :

« Au cas où vous nourririez quelque espoir que Google ne laisserait pas des humains écouter les enregistrements vocaux venus de Google Home et de Google Assistant, cessez d’espérer. Un de ces humains embauché pour examiner les enregistrements vocaux a fait fuiter plus d’un millier d’enregistrements d’Assistant vers une organisation Belge d’informations, laquelle a publié cette semaine un récit et une vidéo à propos de ces enregistrements. Bien entendu, Google en est furax.

Ce que racontent les nouvelles de Flandres n’est pas des broutilles, surtout parce que l’on peut effectivement écouter des tas d’enregistrements de Google Assistant venus de quidams flamands anonymes. Nous savions depuis longtemps que Google emploie des gens pour examiner et transcrire des enregistrements vocaux afin d’entraîner les dispositifs permettant à l’assistant vocal de fonctionner. (Amazon et Apple ont admis procéder de même, et nous avons déjà relaté une vérité dérangeante concernant la raison pour laquelle le recours à des humains est encore nécessaire pour que les assistants vocaux fonctionnent). Manque de chance pour Google, un de ces hommes a expédié une grosse quantité de ces enregistrements à VRT News en Belgique. Cette personne, travaillant en tant que sous-traitant pour Google, a également permis aux journalistes de jeter un coup d’œil au logiciel utilisé pour examiner les enregistrements. Le rapport confirme ce que nous savions déjà, mais l’écoute des enregistrements nous rappelle vivement que ce que l’on dit à un assistant vocal est enregistré, stocké, et risque inévitablement d’être divulgué aux pirates, au gouvernement ou à des organismes belges d’information.

Google a riposté vendredi par un billet de blog présentant la fuite comme une brèche dans la sécurité. L’entreprise expliquait que le processus d’examen est nécessaire au bon fonctionnement de ses produits dans diverses langues, même si le même processus est appliqué aux enregistrements en anglais. Forcément, le blog se lit comme une réprimande :

« Nous venons d’apprendre qu’un de ces examinateurs allophones avait violé nos protocoles de sécurisation des données en faisant fuiter des données audios confidentielles en Néerlandais. Nos équipes de sécurité et de protection des renseignements personnels ont été mobilisées sur cette question, elles enquêtent, et nous allons prendre des mesures. Nous procédons à un examen approfondi de nos sauvegardes dans ce domaine afin d’empêcher ce genre d’inconduites de se reproduire. »

Le billet confirme également que « quelque 0,2% de tous les extraits audios » sont renvoyés à des examinateurs humains. Voilà qui paraît un bien petit nombre, jusqu’à ce que l’on se souvienne qu’un milliard d’appareils peuvent solliciter Google Assistant.

Cependant, le plus préoccupant, à propos de ce coup d’œil sur la façon de faire fonctionner Google Assistant, est le simple fait que beaucoup d’enregistrements sont effectués ‘’par accident’’. Ce logiciel, tout comme d’autres assistants vocaux, est supposé commencer d’enregistrer uniquement après que l’utilisateur ait prononcé un mot de sillage(1), ou une phrase du genre « Hé, Google ! ». Néanmoins, le rapport belge dit : « VRT NWS a écouté plus d’un millier d’extraits, dont 153 consistaient en des conversations qui n’auraient jamais dû être enregistrées et durant lesquelles la commande « Okay Google » n’a clairement pas été prononcée. » Ce qui veut dire que peut-être 10% de ce que Google enregistre relève du domaine de ce qui ne devrait jamais être enregistré.

Ce qui se passe ensuite, donc, n’est pas clair. Peut-être les gens devraient-ils être plus prudents avec leurs Google Home, Amazon Echo ou Apple HomePod, avec tout ce qui équivaut à des dispositifs d’écoute électronique, pensent certains experts de la vie privée. Cette analogie prend de plus en plus de sens au fur et à mesure que nous en apprenons davantage sur le mode de fonctionnement de ces appareils. Un Google Home comporte des micros actifs par défaut et, parfois, enregistre sans votre consentement explicite. Alors ces enregistrements sont envoyés à un sous-traitant que pourrait bien démanger l’envie de les faire fuiter vers la presse. C’est ce qui vient de se passer.

Bien sûr, une autre solution serait de balancer à la mer votre Google Home ou votre Amazon Echo, ou votre Apple HomePod, hurler au ciel, pleurer dans le sable. Ce n’est peut-être pas le futur que vous vouliez ou espériez, mais c’est celui dans lequel vous devriez vivre. »

(fin de citation)

L’opinion avait déjà été informée des méfaits d’Amazon avec son « Alexa », et Adam Clark Estes en fait état ici. « Alexa, disent [les gens], est un espion camouflé dans un dispositif d’écoute. » « On commence à penser que Alexa et autres assistants vocaux sont destinés à nous espionner parce que de tels systèmes ont été conçus pour fonctionner de cette façon. » En effet, ces bizingouins ont besoin de l’intervention humaine pour faire leur « apprentissage » (2). C’est-à-dire qu’il faut des locuteurs humains pour prononcer des phrases, qui seront disséquées d’une part en entités phonologiques (ou plus exactement acoustiques) et d’autres part en entités syntaxiques (ou plus exactement caténaires), tout cela stocké dans de gigantesques mémoires afin de les recomposer ad hoc pour donner l’illusion de la parole humaine. Ce n’est pas de « l’intelligence artificielle », car jamais une bécane ne sera capable d’analyser du signe (au sens saussurien du terme), en tout cas pas maintenant, et de restituer performantiellement cette analyse dans un énoncé. C’est simplement un avatar de la vieille « Eliza »(3), un peu plus perfectionné que son ancêtre. Quand on connaît les bases de « l’apprentissage » des machines, et je travaille sur la question depuis 1992, on se rend compte que ce n’est que de l’algorithmique et des mégadonnées(4) (Großen Daten) et que tout dépend de ce que transmettent les humains à l’électronique.

Et cela fournit un bon prétexte pour écouter les utilisateurs : on enregistre pour accroître, prétend-on, les capacités du logiciel, et l’on refile le décorticage aux sous-traitants. Pardi ! Mais le Großen Daten, ça se vend aux marchands de tout poil… et aux officines gouvernementales qui ne rêvent que de contrôler les citoyens devenus sujets jusque dans l’intimité du logis ! C’est encore plus vicieux lorsque des micros sont subrepticement rendus actifs « par défaut ». Rien que ce détail montre qu’il existe une volonté d’espionner et de nuire, car dans le cas contraire on ne donnerait pas aux ingénieurs d’instructions allant dans ce sens. Et, sieur Macron, ce n’est pas du « complotisme » que de le dénoncer, puisque les faits sont avérés. Je ne serais pas étonné que les mégadonnées transmises par les compteurs « Linky » servent, en matière d’habitudes de consommation de courant électrique, à de telles violations du privé des gens.

La technique, notre mode de transformation du monde, peut être une bonne chose lorsqu’elle sert effectivement les hommes. Lorsqu’elle sert à les espionner, à les contrôler, à les décérébrer, à les faire taire, alors c’est un crime. Il n’y a pas à se réjouir de ce « tout numérique » utilisé pour mettre l’humanité en esclavage au profit d’une poignée de spoliateurs cosmopolites et de tyrans locaux.

C’est pourquoi je ne saurais trop recommander de bannir l’emploi de zimbrèkes à commande vocale connectés à la Toile : à coup sûr vous serez espionnés, et il existe même des appareils de balayage de fréquences et amplification de signaux permettant de savoir ce que vous racontez, même en étant déconnecté. Balancez les téléphones ridiculement sophistiqués, Ipods et autres imbécillités inutiles, ne jetez jamais vos documents personnels sur le Nuage(5) de Microsoft ou d’autres, n’allez plus sur Fesse-Bouc, le Jacassin(6), Instagram. Bref : fuyez les GAFAs (bon, vous pourrez toujours commander une pompe à vélo sur Amazon, cela ne prête guère à conséquence) et n’acceptez pas les « facilités » numériques gouvernementales.

Et s’il y a parmi mes lecteurs des ingénieurs, développez des appareils capables de tenir en échec les tentatives d’espionnage. Envoyez des mégadonnées pourries afin de corrompre à tout jamais le Großen Daten. Bref : pratiquons le sabotage résistant à très grande échelle.

Sacha

(1) Mot de sillage : mot de commande convenu destiné à déclencher vocalement un mécanisme.

(2) En globish, « machine-learning ».

(3)Eliza programmée par J. Weizenbaum dans les années 1964-1966. D’une certaine façon, le jeu Akinator en est un lointain dérivé, basé sur un pseudo-raisonnement en arborescence du type système-expert.

(4) En globish, « big data ».

(5) En globish, « the Cloud »

(6) Tweeter.

Share

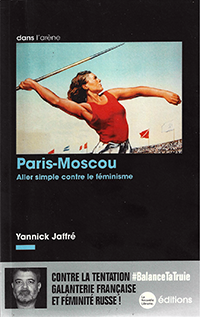

Chez Books on Demand (BoD)

Chez Books on Demand (BoD)

Excellente approche anthropologique de l'immense différence entre les femmes Russes et les horreurs quérulentes à cheveux bleus de chez nous.

Excellente approche anthropologique de l'immense différence entre les femmes Russes et les horreurs quérulentes à cheveux bleus de chez nous.

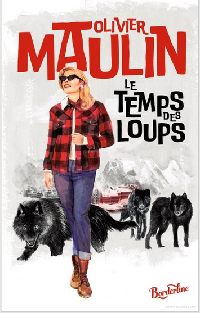

Livre truculent, dont il faut retirer " la substantifique mœlle". Lorsque tout fout le camp, que faire ?

À lire pour rire et réfléchir !

Livre truculent, dont il faut retirer " la substantifique mœlle". Lorsque tout fout le camp, que faire ?

À lire pour rire et réfléchir !

Très instructif. À méditer !

Très instructif. À méditer ! D'où viennent-ils ? Qu'ont-ils vu ? Quel est le combat ?

Pensée et testostérone !

D'où viennent-ils ? Qu'ont-ils vu ? Quel est le combat ?

Pensée et testostérone !

Insigne des Masques Jaunes :

adoptez-le, portez-le !

Insigne des Masques Jaunes :

adoptez-le, portez-le !

Bon ! À vos portefeuilles !

Bon ! À vos portefeuilles !

ASSEZ DE BARBARIE !!!

ASSEZ DE BARBARIE !!!

et toutes les formes de fascisme dont le socialisme.

Notre "antikons" a le droit d'aînesse :)

Que de tels mouvements naissent chez nous et dans toute l'Europe !

et toutes les formes de fascisme dont le socialisme.

Notre "antikons" a le droit d'aînesse :)

Que de tels mouvements naissent chez nous et dans toute l'Europe !